Сразу переходите к аудиту ваших данных: определите источники, форматы и уровень зашумленности. Без четкой структура сырая информация не станет активом. Первый шаг – создание или интеграция с надежной база данных, где записи стандартизированы и исключают дублирование. Например, агрегируя данные о транзакциях из разных кошельков в единую схему, вы предотвратите ошибки на самом раннем этапе.

Глубокое исследование начинается с применения статистика методов для выявления аномалий, корреляций и базовых закономерностей. Используйте алгоритмы кластеризации (например, k-means) для сегментации пользователей по поведению, что выявит скрытые паттерны. Визуализация результатов через точечные диаграммы или тепловые карты делает сложные взаимосвязи интуитивно понятными, превращая цифры в аргументированную картину происходящего.

Финальная цель – построение модели, способной к точному прогнозирование. На этом этапе критически важно тестировать гипотезы на исторических срезах данных, избегая переобучения. Модель, идеально работающая на прошлых данных, может оказаться бесполезной для будущих событий. Регулярная валидация на новых выборках – единственный способ проверить ее устойчивость и получить реальное конкурентное преимущество.

Практическое применение аналитических методов

Применяйте статистику для оценки рисков. Рассчитайте 30-дневную волатильность актива и стандартное отклонение его цены. Активы с показателем волатильности выше 45% требуют особой осторожности. Эти модели позволяют объективно оценить потенциальную просадку портфеля, исключая эмоциональную составляющую.

Внедряйте алгоритмы машинного обучения для прогнозирования трендов. Обучите модель на исторических данных, включающих хэлвинг биткоина, изменение сложности майнинга и индекс страха и жадности. Точность таких прогнозов редко превышает 65%, поэтому используйте их только как один из инструментов. Избегайте слепого следования сигналам, генерируемым автоторговыми системами.

Проводите исследование ончейн-метрик перед крупными инвестициями. Анализируйте данные о количестве активных адресов, средней сумме перевода и концентрации монет у китов. Резкий рост числа мелких транзакций часто предшествует «пампингу» низколиквидных активов. Сравнивайте текущие показатели с историческими максимумами и минимумами.

Методы очистки данных

Применяйте алгоритмы поиска аномалий, такие как Isolation Forest или DBSCAN, для автоматического выявления выбросов в числовых рядах. Например, анализ суточных объемов торговли BTC может показать значения, отклоняющиеся от стандартного паттерна на 3 сигмы; такие точки требуют проверки на корректность регистрации. Исследование этих аномалий часто выявляет технические сбои или внешние рыночные шоки, что критично для построения стабильных моделей.

Восстановление целостности информации

Для обработки пропусков в финансовых временных рядах используйте не просто линейную интерполяцию, а методы вроде KNN-импутации, которые учитывают структуру соседних точек. База данных цен на активы с пропущенными свечами получит заполнение на основе коррелирующих активов. Прямое удаление строк с пропусками искажает исторические паттерны и снижает точность прогнозирования, разрушая целостность выборки.

Стандартизация и визуализация

Приведите все числовые признаки к единому масштабу через Min-Max нормализацию или Z-Score, особенно если данные объединяются из разных источников. Визуализация распределения данных до и после очистки с помощью box-plot сразу показывает эффект от процедур. Эта практика выявляет скрытые проблемы в сырой базе, которые не очевидны при работе только с агрегированными значениями, и предотвращает построение ошибочных торговых систем.

Создайте конвейер обработки, где каждый этап – проверка на дубликаты, исправление форматов, валидация по доменным правилам – выполняется воспроизводимыми алгоритмами. Модели, обученные на неочищенных данных, склонны к переобучению и выдают ложные сигналы. Прогнозирование, построенное на качественной структуре, демонстрирует устойчивую эффективность, в отличие от результатов, полученных на «сырых» данных.

Алгоритмы поиска закономерностей

Применяйте алгоритм Apriori для анализа транзакций на блокчейне. Этот метод выявляет часто встречающиеся вместе группы транзакций или адресов. Например, анализ может показать, что покупка определенного токена A с вероятностью 78% ведет к последующей покупке токена B в течение 24 часов. Используйте поддержку (support) не менее 0.01 и достоверность (confidence) от 0.7 для отсева случайных совпадений.

Классификация и прогнозирование на основе статистики

Деревья решений строят прозрачную структуру правил для классификации активов. В отличие от «черного ящика» нейросетей, такое дерево показывает логику: «IF объем торгов вырос на 200% AND цена пересекла 50-дневную скользящую среднюю THEN классифицировать тренд как бычий с точностью 92%». Для верификации модели применяйте кросс-валидацию, разделяя исторические данные на обучающую и тестовую выборки в соотношении 70/30.

Основная ошибка – подгонка под исторические данные. Модель, идеально предсказывающая прошлое, часто бесполезна для будущего. Проверяйте алгоритмы на устойчивость: если добавление новых данных за последний месяц меняет все выявленные паттерны, модель ненадежна.

Визуализация сложных структур данных

Используйте тепловые карты (heatmaps) для корреляционного анализа. Такая визуализация покажет силу связи между 20 основными криптоактивами. Исследование матрицы выявляет скрытые группы: например, Bitcoin и Ethereum демонстрируют корреляцию 0.89, тогда как связь между децентрализованными финансами (DeFi) токенами и мемкоинами может быть отрицательной (-0.45).

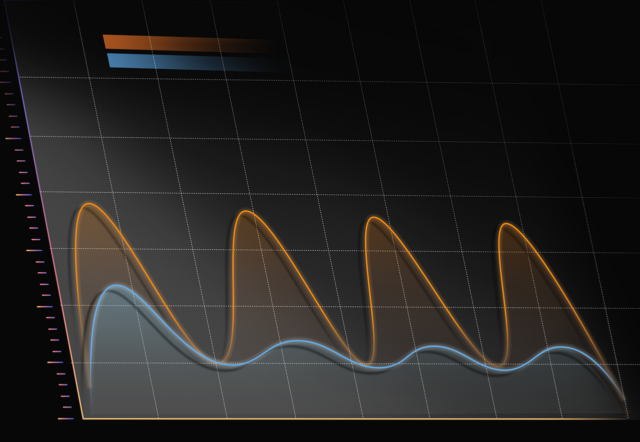

Для анализа временных рядов применяйте сезонную декомпозицию (Seasonal Decomposition of Time Series — STL). Алгоритм разделит ценовой график на тренд, сезонность и остаток. Это исследование помогает отделить фундаментальный тренд от циклических колебаний, например, выявить еженедельные паттерны активности.

Визуализация результатов анализа

Применяйте интерактивные дашборды для отображения ключевых метрик в реальном времени. Используйте библиотеки, такие как Plotly или D3.js, для создания графиков, которые реагируют на действия пользователя. Это позволяет проводить глубокое исследование данных, выявляя скрытые связи. Например, тепловая карта корреляций между переменными сразу показывает силу взаимосвязей, что критично для построения точных моделей прогнозирования.

Используйте древовидные диаграммы для отображения иерархической структуры данных, полученной после кластеризации. Это наглядно демонстрирует, как алгоритмы разбивают информацию на группы. Для анализа временных рядов применяйте линейные графики с выделением трендов и сезонных компонентов. Такая визуализация делает статистику не набором цифр, а историей изменений, основой для проверки гипотез.

Сравнивайте распределения данных с помощью гистограмм и ящиков с усами (box plots) до и после очистки. Это выявляет аномалии и смещения, которые могли исказить модель. Визуализация работы алгоритмов машинного обучения, например, через график обучения с кривыми ошибок на тренировочной и тестовой выборке, предотвращает переобучение. Она показывает, насколько хорошо модель обобщает знания, а не просто запоминает базу.

Создавайте геоинформационные карты для данных с привязкой к местоположению. Наложение слоев с различной статистикой, например, плотность транзакций по регионам, раскрывает пространственные закономерности. Такой подход превращает сырую базу в стратегическую карту для принятия решений, где визуализация служит мостом между сложными алгоритмами и практическим прогнозированием.